※ このブログでできること

- 無料AIだけで“ワンポイント動画”を作る方法が分かる

- Stable Diffusion → ComfyUI → Shotcut の流れが理解できる

- 画像生成の初心者でもつまずかない

- StabilityMatrix を使うと作業が一気に楽になる理由が分かる

例えば自分の演奏を動画にアップするとき、アニメの挿絵が欲しかったりします。

ワンポイントで振り返る少女とかいいですね。

ここでは、無料のAIツールを使用して2D画像から、ワンポイント動画の作成までを

スクリーンショットなどを多用して紹介していきます。

いらすとややCopilotなど身近なツールもどんどん使っていきます。

またStabilityMatrixという無料ランチャーアプリでは、複数の画像生成ソフトが使えます。

そちらについては下のリンクで解説しています。

AI画像生成初めてはStabilityMatrixが近道だった

この後の内容をスムーズに理解するには、上の記事を先に読んだ方がいいかもしれません。

初心者用にかみ砕いて説明しています。(私が初心者!)

ちなみに、最短と言えどまる1日くらいはかかりますね。要覚悟!

※ 一度環境を作ってしまえば、驚くほど速くできますよ!

どんな動画ができる?

ここでは、 「静止画の一部だけが動く短いAI動画」 を無料ツールだけで作る方法を紹介します。

まずは例をご覧ください。

画像の好みは置いておいて、こんな感じです。

正直いって、長い動画はパソコンのスペックも高くないとできませんし、

失敗の可能性も高いです。

この動画は

・Stable Diffusionを使用してベースの画像を作り、

・ComfyUIを使ってプロンプト(命令文)で一部だけ動かし、

・動画編集ソフトShotcutを使用してつなげてあります。

全部無料です!

※ Stable DiffusionもComfyUIもStabilityMatrixというランチャーソフトに入っています。

StabilityMatrix は、Stable Diffusion や ComfyUI を まとめて管理できる無料ランチャーアプリです。

AI画像生成初めてはStabilityMatrixが近道だった

ランチャーソフトは、

複数のソフトをまとめて管理するソフトのことにゃ。

マインクラフトランチャーとか聞いたことがあるかもしれないにゃ。

※ Stable Diffusionはオンラインがあるんですね。

私は勉強不足でしりませんでした。

今度使用してみようと思いますが、今回はリンクだけ貼っておきます。

こんなのや、

こんなのを、無料でオリジナル曲のPVに入れられたらいいと思いませんか?

何が何だかわからないかもしれませんーでも大丈夫ぼちぼち読んでいけば理解できます

まずは画像から!

Stable Diffusionは画像生成では強力なツールです。

水着などのきわどい画像も生成できるので自由度が高いです。

その代わり思い通りにできるかは運次第で、たくさん生成する必要があります。

ここではベース画像はもっと簡単に作ってしまいます。

身近にある画像ツール

皆さんのPCにCopilotは入っていますか?

古いスペックだとないかもしれませんね。でも大丈夫。

Microsoft Edgeでも同じことができます。

ブラウザの右上にこんなのがありませんか?

ここでチャットしながら画像を生成ダウンロードできます。

Copilotというとあまりプロっぽくない、通じゃない感じがします。

また簡易的のものという印象を持つ人もいるでしょう。

でも実際には GPT 系のエンジンが中で動いているので、

イメージほど弱いツールではありません。

最大の強みはプロンプト(英単語)など一切なしで日常の日本語で画像を作れることでしょう。

・「振り返る少女を描いて」

・「月をバックにギターを弾く人を描いて」

こういう普通のお願いで十分伝わります。

Copilotにお願いして一から作ってもらう

最初にタイムトラベルしながらjamセッションする

髪の長いギタリストが率いるバンドの絵という注文をしました。

この時点ではギタリストが少し女性ぽい感じがします。

そこで体形は華奢でもいいけど男性にしてほしい。

ギターはストラトがいい。

天気のいい日中に大きな公園のベンチで座っているところなどの注文を追加します。

月光でエビぞりになってギターを弾くシルエットもお願いします。

月をバックにとかも。

なんといらすとや利用でAI加工もいける!

いらすとやは皆さん知っているフリー画像の聖地ですね!

著作権フリーでどんどん使えます!

ある日私はブログの吹き出しキャラように画像をダウンロードしました。

たくさん疑問で質問をする初子ちゃんとしました。

初子ちゃんをエフェクター改造ブログ風に着替えさせてもらいます。

Copilotにロック風のくろいTシャツに着替えさせてほしいとお願いします。

私が初子。

こうやって誕生したんだよ!

後日エフェクターが壊れたので、パロディ記事を書きました。

そうだ、ここで初子の涙の画像が欲しい!

Copilotに「訃報を聞いて号泣する初子を書いて」とお願いします。

※ この時一応初子の画像はCopilotに添付したほうが確実です。

その時のCopilotの答えが、

「リアル系もできるけどどうする?」

「お願いします」

できた画像がこちら

元がいらすとやだと考えると、なんだかすごくないですか?

いらすとや → リアル化 → 動画化が強い理由

① ポージングが最初から完璧

いらすとやのキャラは、

- 立ち姿

- 座り姿

- 振り返り

- 驚き

- 泣き

- 走り

- ギターを持つ

- 楽器を弾く

など、人間の動作が“整理された形”で描かれている。

AIにとっては、 「ポーズが破綻していない画像」=動かしやすい素材。

だから、リアル化しても破綻しにくい。

② 線がはっきりしているので、AIが“構造”を理解しやすい

いらすとやの特徴:

- 線が太い

- 色が単純

- 形が明確

これは AI にとって “どこが腕で、どこが顔で、どこが髪か” を理解しやすい。

その結果:

- リアル化が綺麗に決まる

- ComfyUI で動かすときも破綻しにくい

- 動きの指示が通りやすい

つまり、AI動画の素材として理想的なんだ。

ComfyUIを使って画像を動かしていく&プロンプトはCopilotにお願いする

StabilityMatrixからComfyUIを立ち上げます。

今回私の環境のStabilityMatrixがぶっ壊れていたので、再インストールから始まりました。

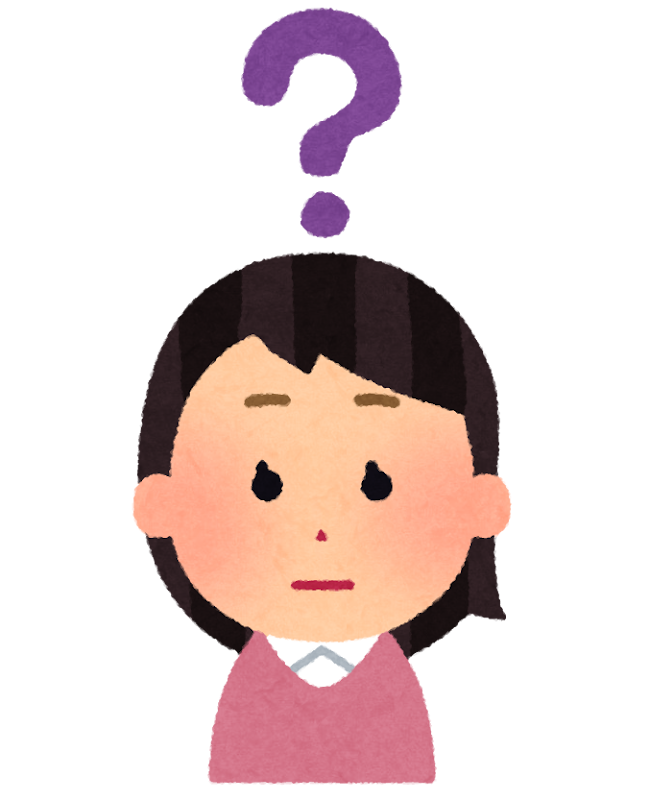

Stability Matorixダウンロードから

もし私の文章でわからなければ、この方の動画を参考にするといいです。

私ももちろん参考にさせていただいております。

上のリンクからzipファイルをダウンロードして解凍。

その中のexeファイルを実行すれば、

必要な依存関係など一括インストールしてくれます。

zipファイルの場所がわかりにくいです。

ダウンロードする場所ですが、Stability Matrixのgithubページにアクセスし、

githubのページ中段に上の画像のようなところがあります。

赤丸のwindows10,11というところをクリックすると

ZIPファイルのダウンロードがはじまります。

StabilityMatrix-win-x64.zipですね。

ZIPを解凍(すべて展開)すると、中にexeファイルがあります。

exeファイルはデスクトップにでも貼っておくといいでしょう。

これがアプリの起動ボタンになるのでそのままが便利かも。

結構大きいファイルになるので、私はDドライブの直下にSMというフォルダを作りました。

※ フォルダ名について

私は面倒でSMにしましたが、普通の方はStability Matorixなどにするでしょうね。

わからなくならない名前で大丈夫ですよ。

※ いくつか注意点。

・まずインストールしたいフォルダにexeファイルは置かないこと。失敗になります。

今回の私で言えば、D/SMの中ですね。

・exeを実行すると保存場所の選択画面があります。

その時にPortableのチェックを外さないとフォルダの選択はできないんです。

・Portableは、Stability Matorixを丸ごと別の環境、ドライブに動かせるものですが、

私はぶっ壊れてしまった経験があるので使いません(笑)

これで普通はすんなりいきます。

※ もしうまくいかない方!esetを使っていませんか?

私は一時停止でもインストールできませんでした。

eset側で除外するか、いったんesetをアンインストールするしかなさそうです。

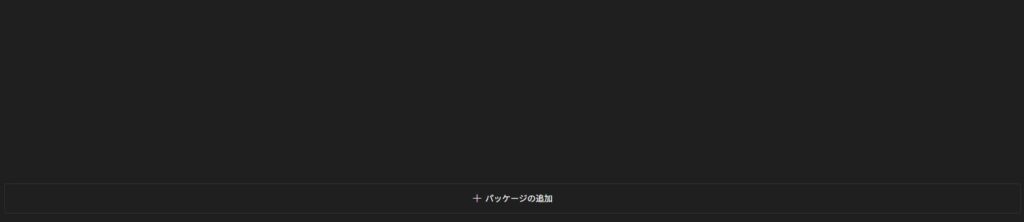

やっとこさComfyUIを導入

Stability Matorixで最初に出てくる色々追加してください画面はいったんスキップしたほうがいいです。

あらためてインストール時と同じStabilityMatrix.exeを右クリック、

管理者権限で実行します。

警告が出ても詳細などをクリックすると実行ボタンがあるので続けます。

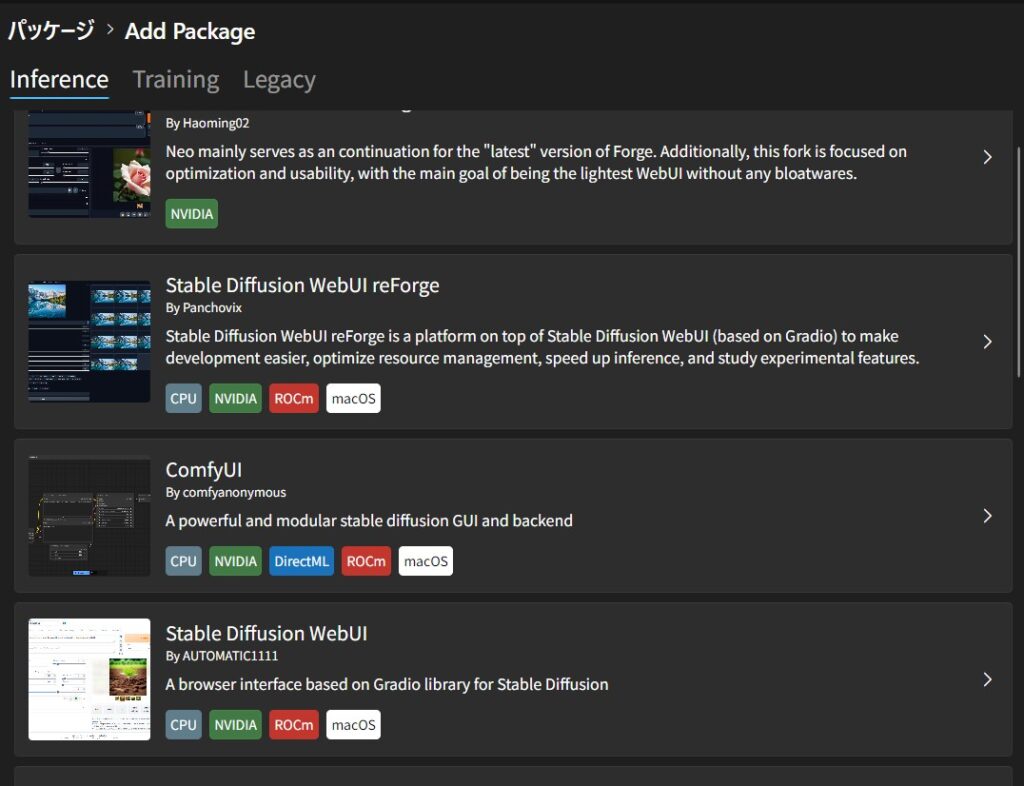

画面が立ち上がると、下の方にパッケージの追加がでてきます。

全画面にしないと出てこないかもしれません。

その中からインストールしたいパッケージを選択。

今回はComfyUIを選択します。

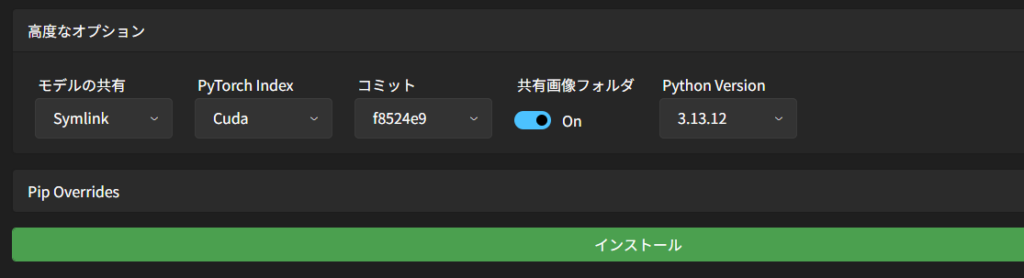

インストール画面では、高度なオプションを開いて、

画像一番右のpython versionを3.10.xxにしておくと安定すると思います。(任意です)

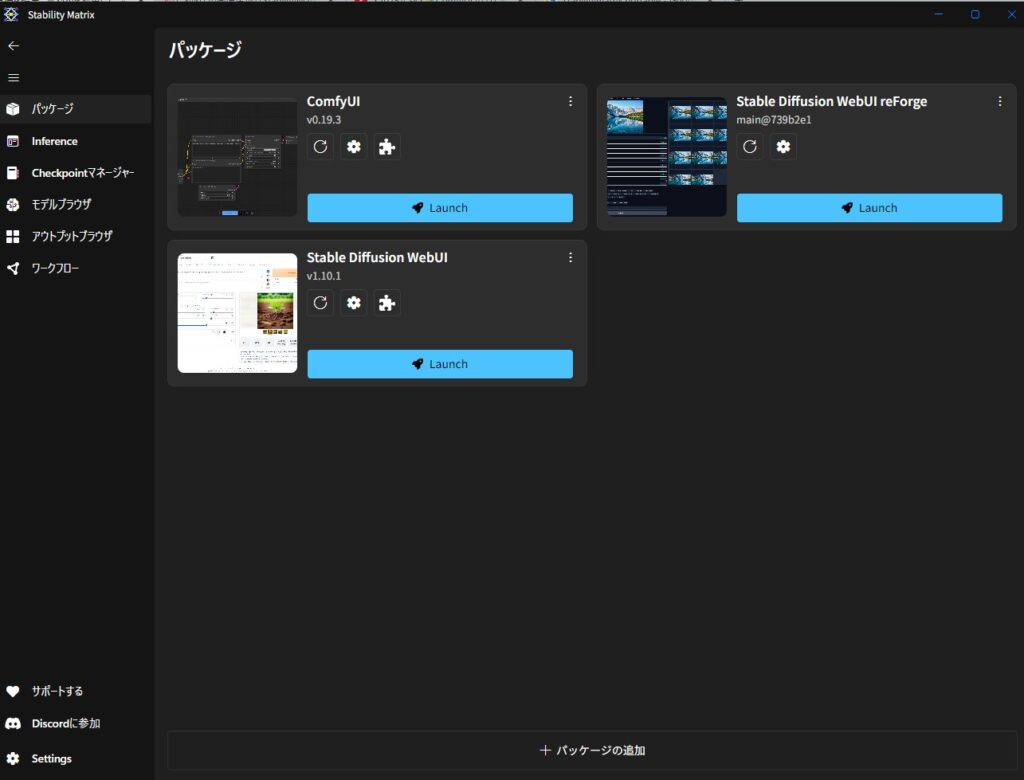

インストールされるとこんな感じになりますよ。

Launchすれば起動します。

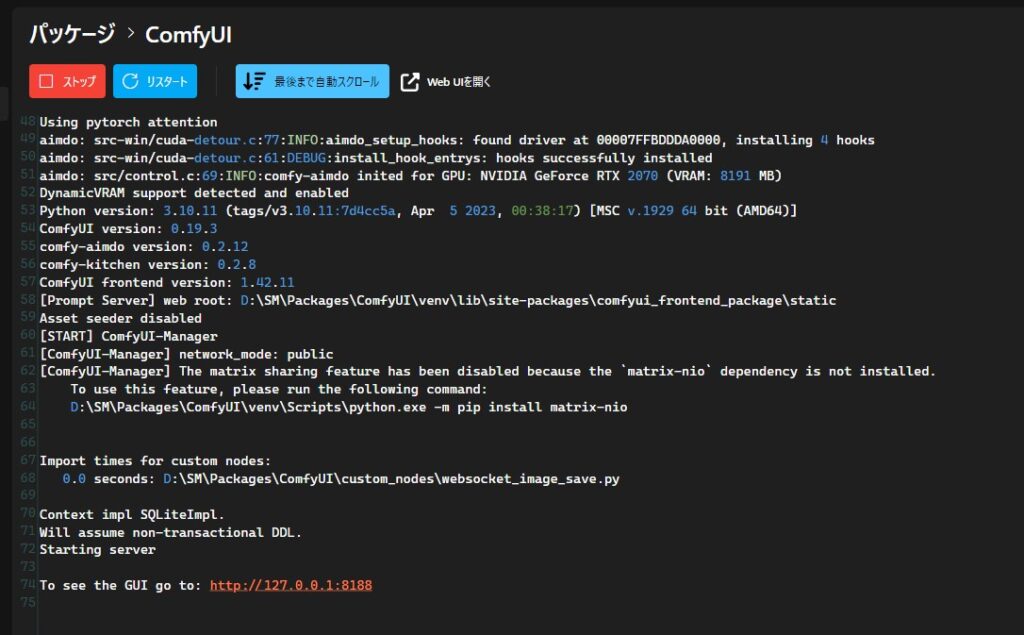

起動に関して最初は驚くかもしれません!

画像の一番上にWebUIを開くとあります。

または一番下のhttp://~~~~~~をクリックすることで、

ブラウザにアプリが現れます。EdgeやChromeにということです。

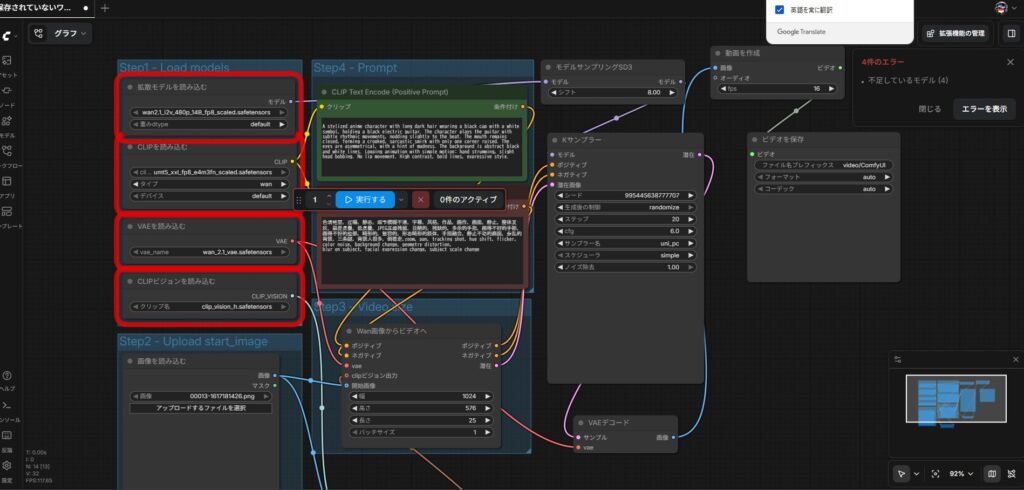

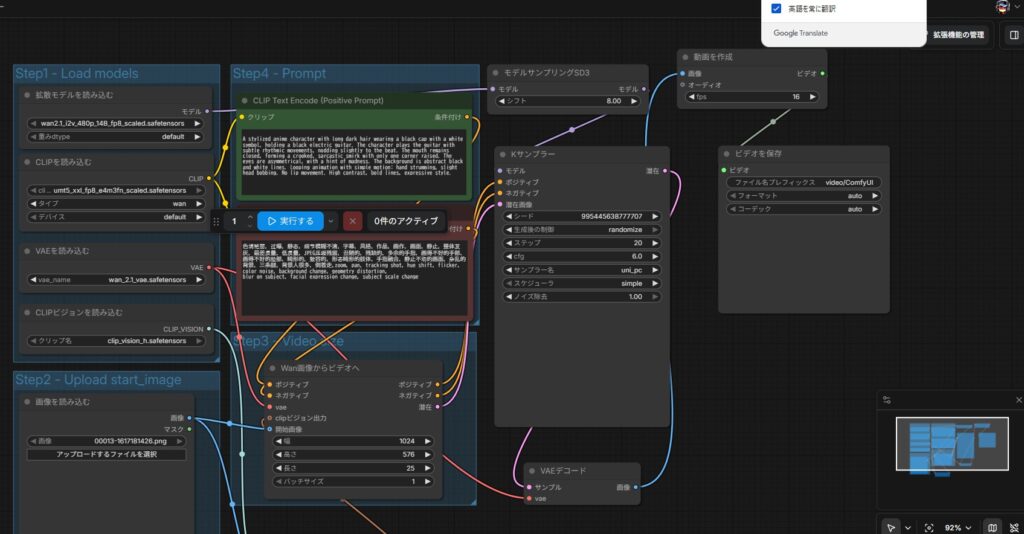

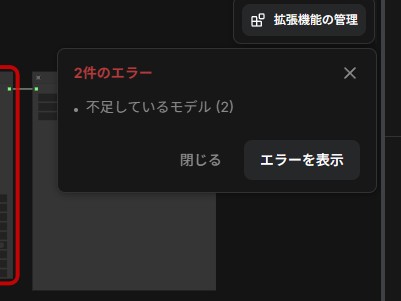

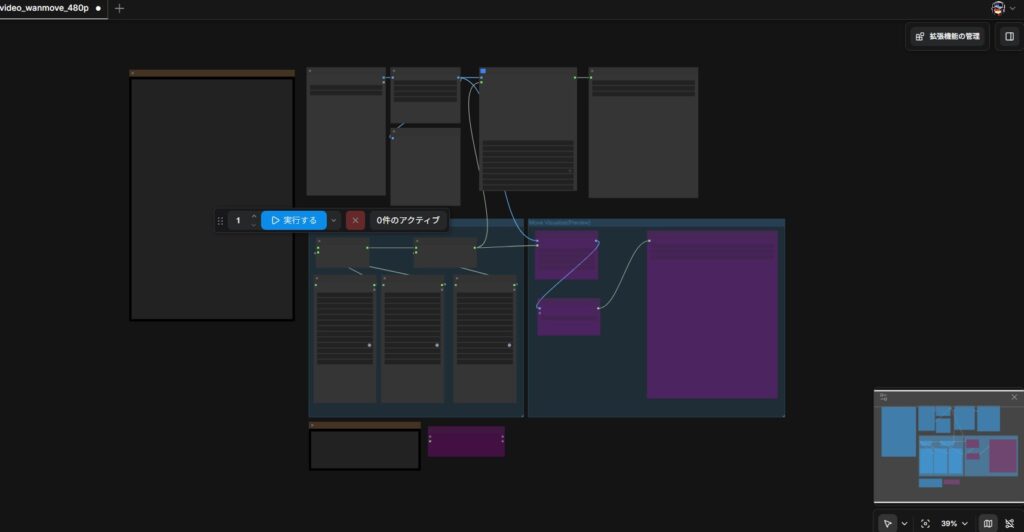

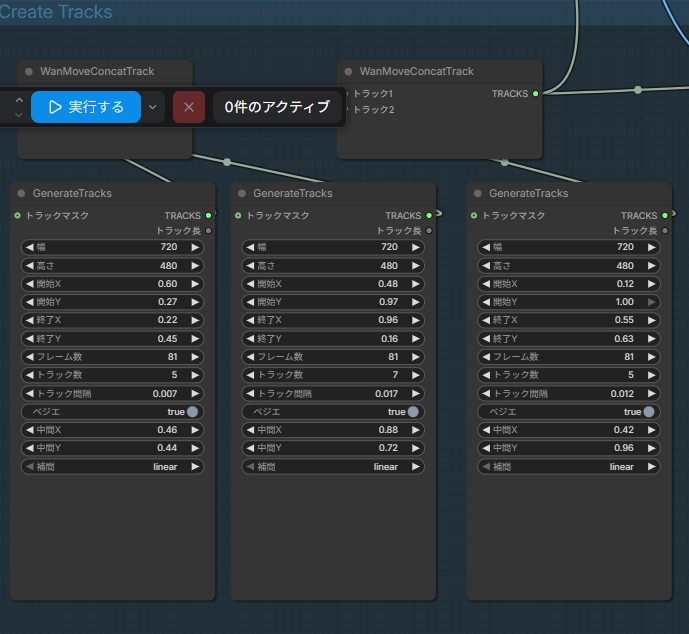

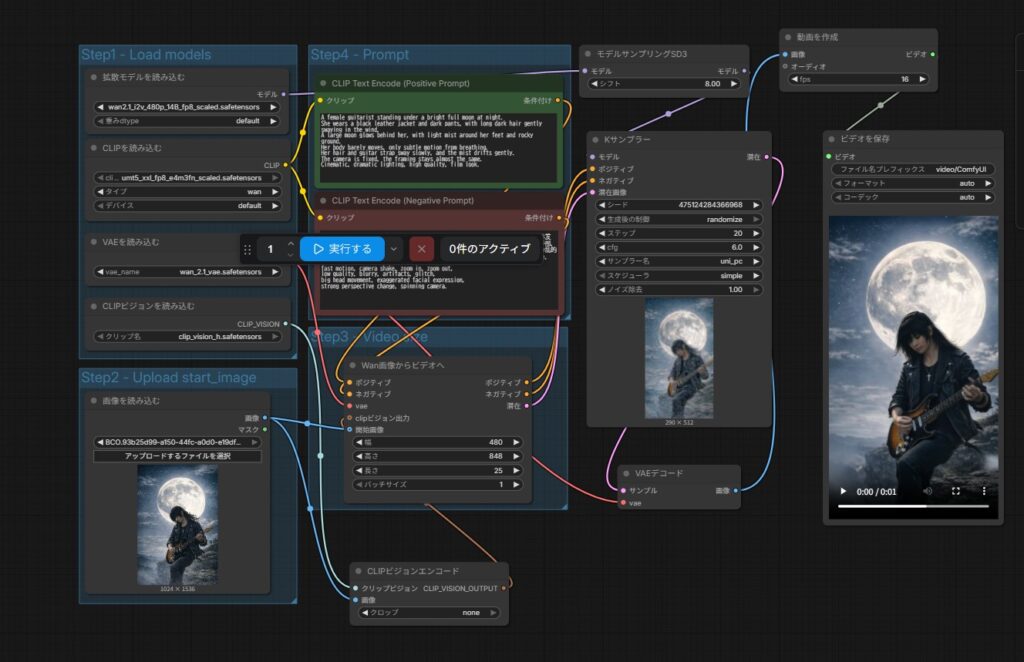

これはもうワンポイント動画を作るためのnode(ブロックみたいなもの)ですが、

見ての通り動かすには足りないものがあるようです。

足りないものを依存関係などといいます。

「依存関係が足りない」なんてこれから聞いたらこういったことです。

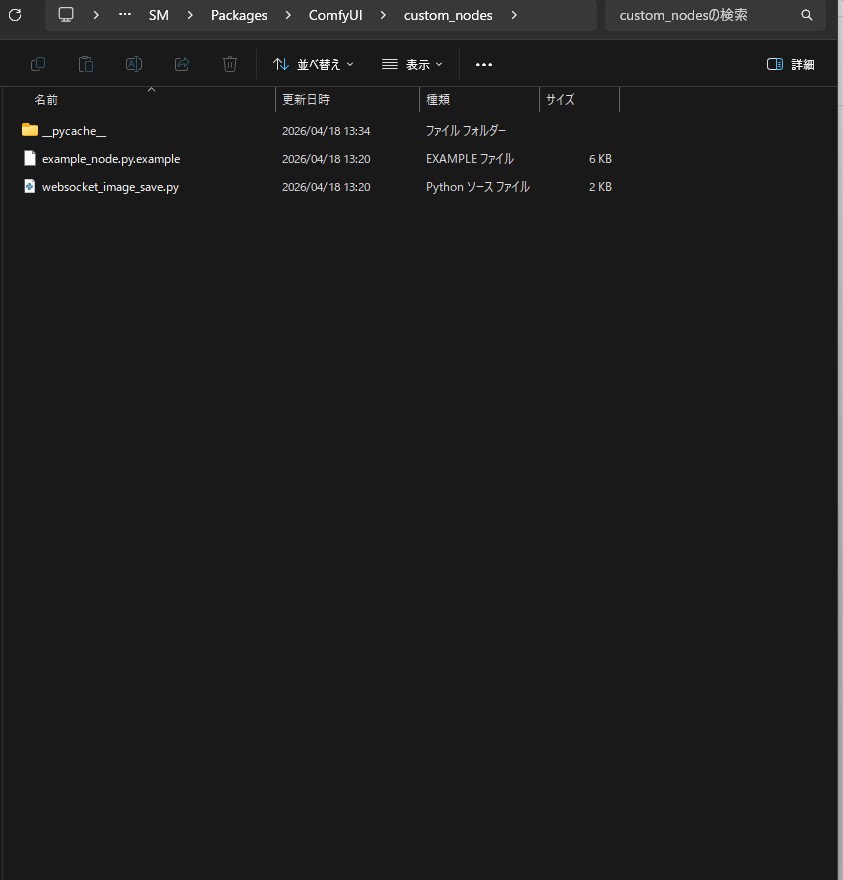

便利ツールComfyUIマネージャーの導入

黒い画面を使用します。あの字だけのやつです・・・・

でも大丈夫ですよ。案外。

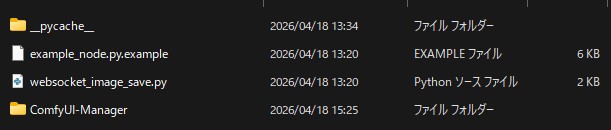

先ほどインストールしたフォルダ。私ならSMというフォルダですね。

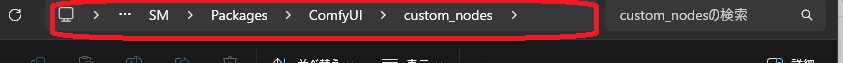

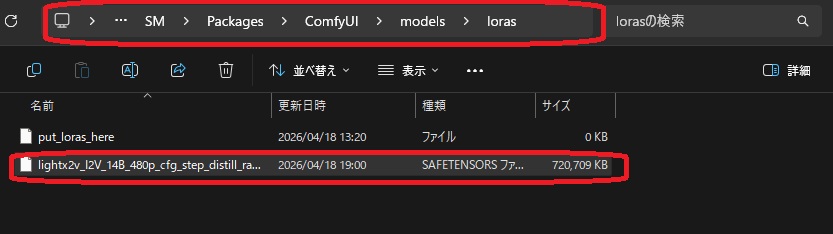

フォルダ内を SM→Pakages→ComfyUI→custom_nodes と進んでいきます。

ここで画面の広い部分を右クリックで、「ターミナルで開く」を選択するか、

赤い部分をクリックして「cmd」と入力してエンターを押します。

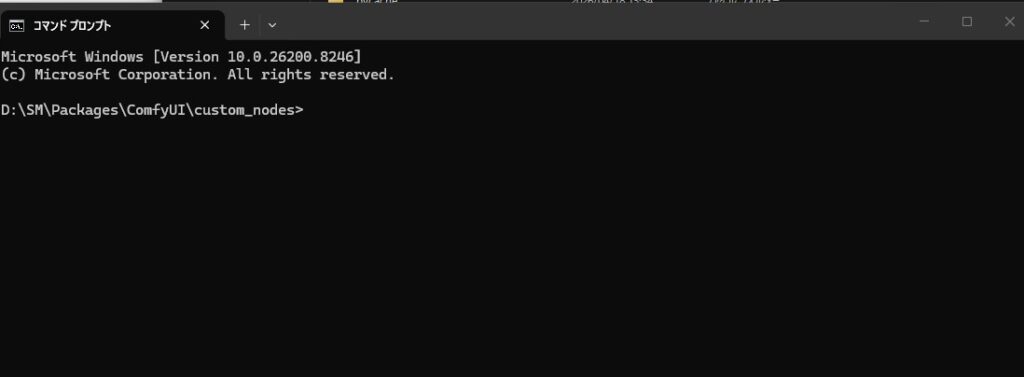

こんな画面がでてきますので、

表示されている文字の後ろに入力します。

git clone https://github.com/Comfy-Org/ComfyUI-Manager.git

コピーしてエンターを押してくださいね。

成功したらこのようになります。

AIを動かすためのデーター入手サイトcivitaiの登録

今回は画像から動画を作るので必要ないのですが、

このサイトの登録は必須です。

AIを動かすためのデータ=モデル(model)

AI画像生成では、 AIがどんな絵柄で描くかを決めるデータのことを「モデル」と呼びます。

モデルには大きく2種類あります。

① Checkpoint(チェックポイント)=土台のモデル

- 絵柄そのもの

- 写実的か、アニメ風か

- 色の雰囲気や光の表現

こういう“画風の大部分”を決めるのがチェックポイント。

例:

- Realistic Vision(リアル系)

- Counterfeit(アニメ系)

チェックポイント=AIの脳みその本体

② LoRA(ロラ)=土台に追加する“味付けデータ”

- 衣装

- キャラの顔

- 特定のポーズ

- 特定の画風のクセ

“細かい特徴”を後から足すためのデータ。

LoRA=着せ替え・追加のクセ

※ チェックポイント+LoRAの組み合わせを、この記事ではまとめて“モデル”と呼びます。

登録は無料です。

サインインを押すとこのような感じで画面がでますので、新規登録します。

グーグルのアカウントなど使うと簡単でしょう。

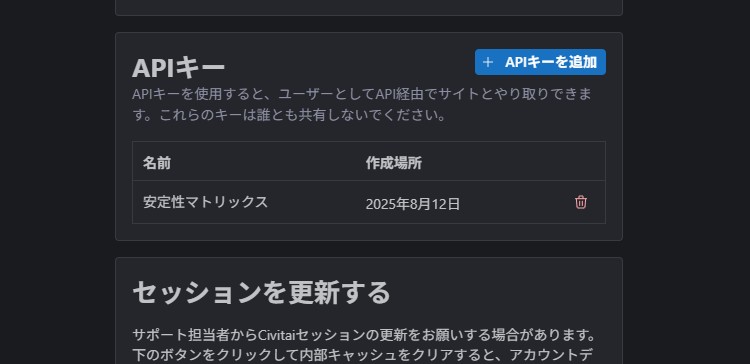

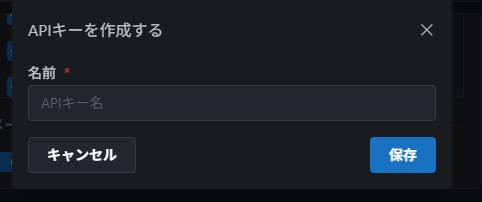

登録するとAPIキーがもらえるので、こちらが重要になります。

ログイン出来たら、自分のアイコンをクリックすると帯がでてきます。

一番下の歯車アイコンをクリック。

ずっと下までスクロールしていくと、

キーを追加してください。

名前はStability Matorixでよいようです。

このキーはずっと使うのでPCにコピペしておくことをお勧めします!

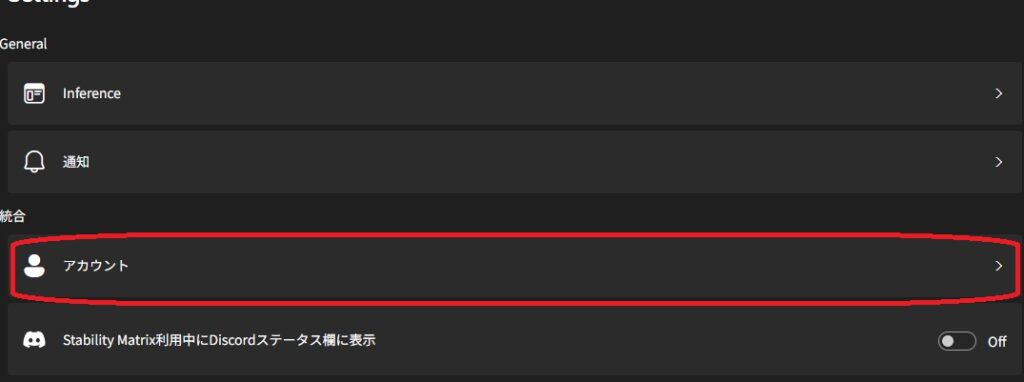

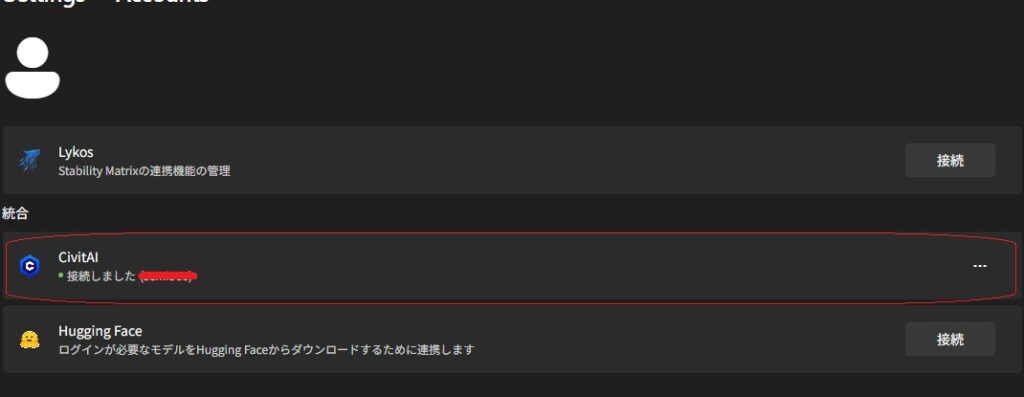

StabilityMatrixとcivitaiとの連携

Stability Matorixの左下、歯車アイコンを開きます。

アカウントを押します。

画像はもう私が連携しちゃってますが、ここでキーを入力して連携してください。

VAEモデルの導入

もうなんだかわからんですよね。

私もよく知らないです。(笑)

画像作成に必要なものと思っておけば大丈夫です。

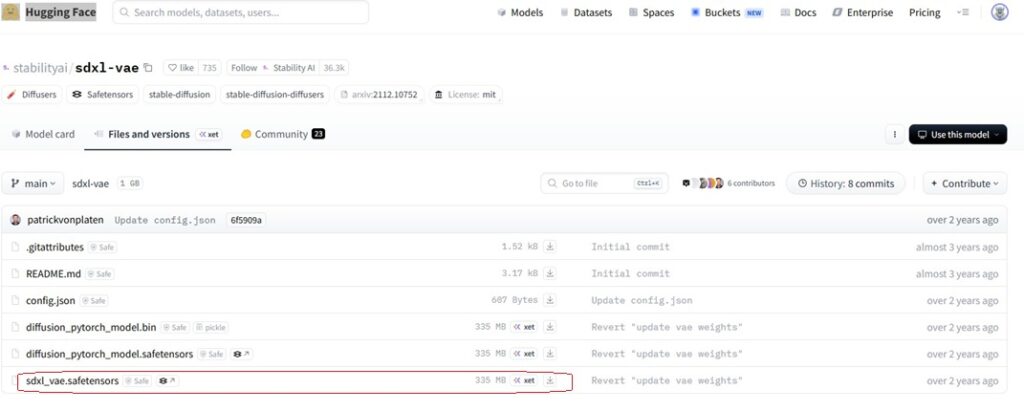

まずはこちらにアクセスします。

sdxl_vae.safetensorsというものをダウンロードします。

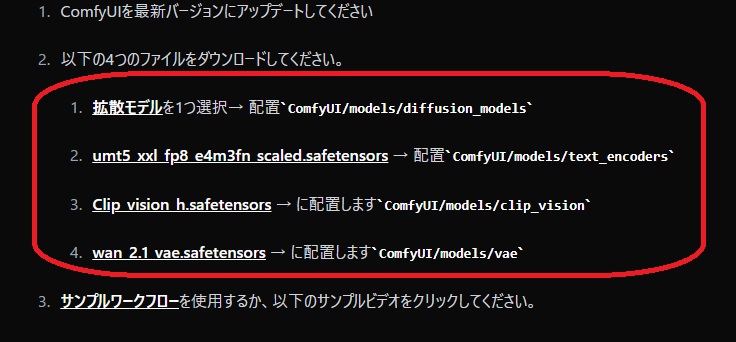

wan2.1の準備

またよくわかりませんね。動画の作成に必要です。

こちらにアクセスします。

動画制作に革命を起こそう:ComfyUIでWAN2.1がサポート開始

下の方にスクロールしていきます。

クリックして、4つ全部ダウンロードします。容量でかいです!

1の拡散モデルに関してはクリックダウンロードとはいきませんで、

開くとこんなに出てきちゃいます。

赤く印をつけた部分がダウンロードするものですが、

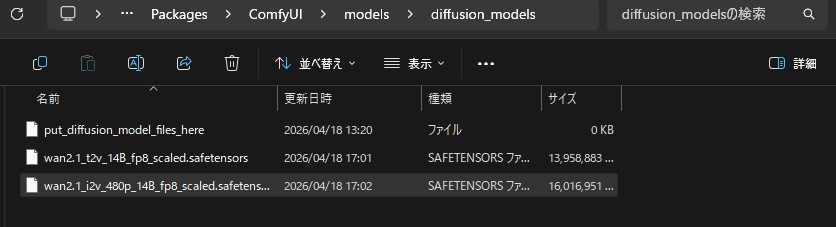

wan2.1_i2v_480p_14B_fp8_scaled.safetensors

wan2.1_t2v_14B_fp8_scaled.safetensors

ダウンロードするのはこの2つです。

※ 名前にi2vとt2vがありますが、

iはイラストから、tはテキストから動画を生成するという意味ですね。

ちょっと面倒ですが、もう少しですので頑張りましょう!

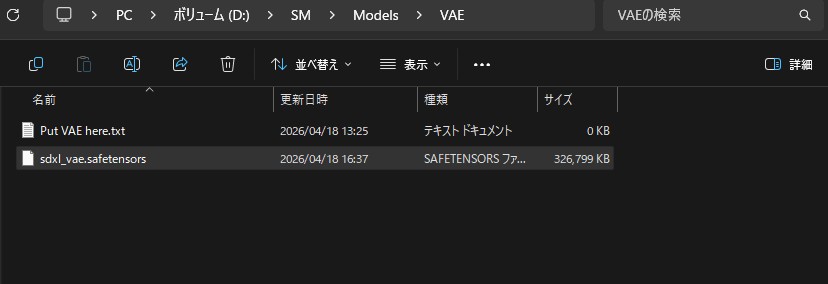

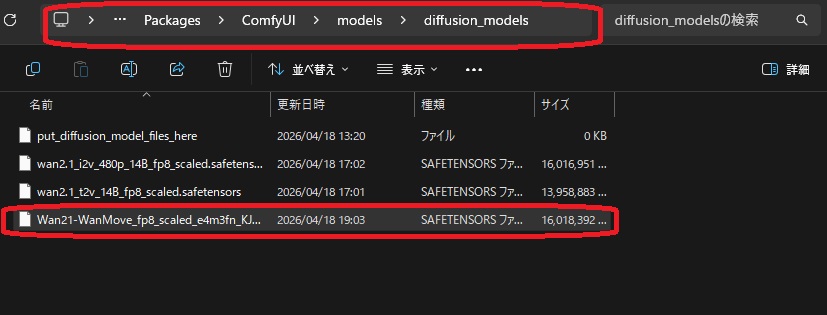

ダウンロードしたファイルの配置

・sdxl_vae.safetensors

私のパソコンでは、Dドライブ、SM→Models→VAEに保存

・wan2.1_i2v_480p_14B_fp8_scaled.safetensors

・wan2.1_t2v_14B_fp8_scaled.safetensors

SM→Packages→ComfyUI→models→diffusion_modelsに格納します。

・umt5_xxl_fp8_e4m3fn_scaled.safetensors

SM→Packages→ComfyUI→models→text_encodersに格納します。

・Clip_vision_h.safetensors

SM→Packages→ComfyUI→models→clip_visionに格納します。

・wan_2.1_vae.safetensors

SM→Models→VAEに格納します。

ComfyUIを立ち上げてみる

まずこのブロック構成ですが、私が作ったわけではないんです。

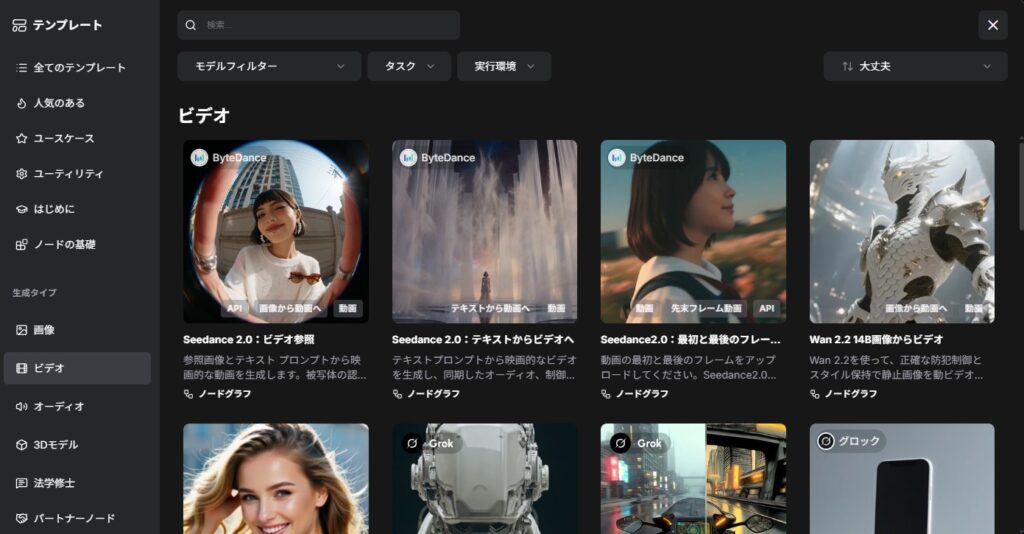

ComfyUIの左側のテンプレートをクリック。

その中のビデオをクリック。

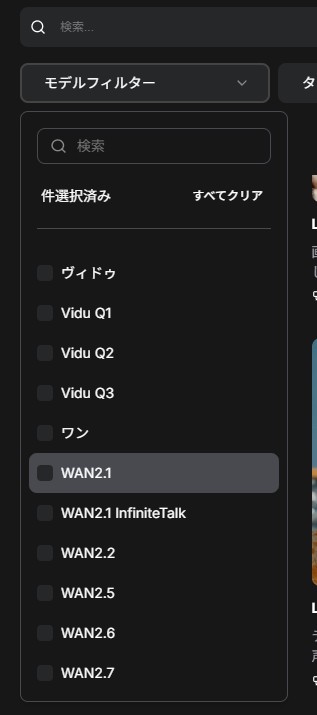

検索窓の下にモデルフィルターというのが見えます。

今回設定したのはwan2.1なのでそちらを選択します。

この中から「画像から動画」を選択すると今回の趣旨に合ったものが現れます。

もちろんテキストから動画も作れますが、

そうするには checkpoint 等が必要になってきます。

試しにこれをクリックしてみました。

足りないモデルがあるようです。

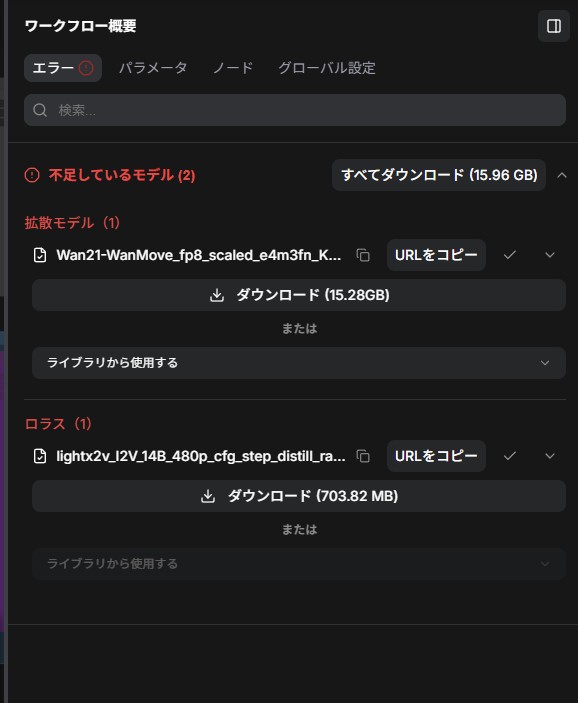

エラーを表示してみると、ダウンロードに案内されます。

素直にダウンロードしてみましょう。

ファイルの格納の情報はないので、さっきのwan2.1と同じ場所、

ロラはロラと書いてある場所に格納してみます。

新規のエラーを出ているタブを閉じようとすると、保存しますか?とメッセージがでるので、

素直に保存して、ComfyUIを再起動してみます。

おお、モデルの不足が消えていますね!

マウスをスクロールして拡大すると、

色々書いてありましたこれで安心。

おまたせ!ワンポイント動画を作ろう!

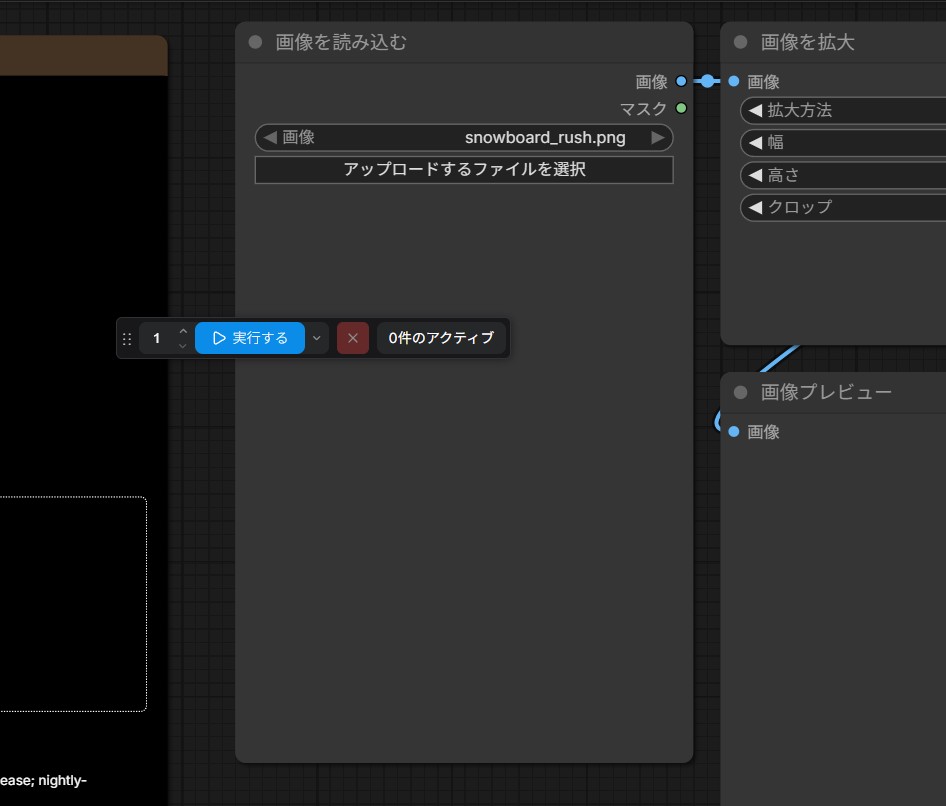

まずここに画像を入れるんだね。

ファイルを選択から選べた。

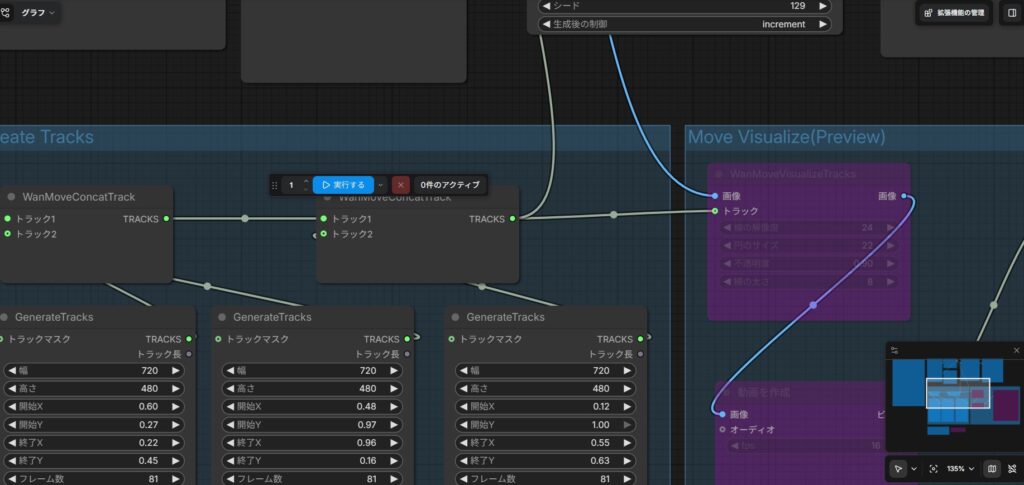

このタイプはプロンプトではなく、下の画像の部分から座標をセットして動かす用です。

私は知らなかったので、何もいじらずに実行しました。

処理は結構重くて時間がかかりました。

設定は全然わからない・・・・

でも一応やってみるか。

おお、何も設定せずに動いた!動画ができました!

CL9の訃報を受けて号泣する初子です。

いつものやつでやってみよう。

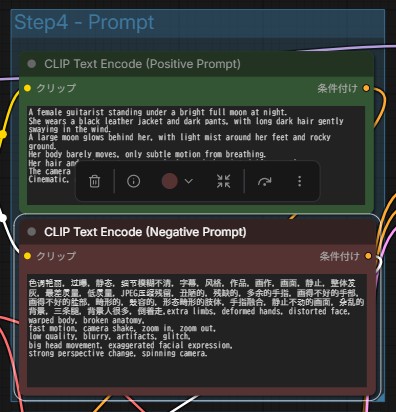

こちらはプロンプト(文章)で、指示を出します。

テンプレートの情報がなくてすいません!

どうやらもう古いようで、同じテンプレートがありませんでした。

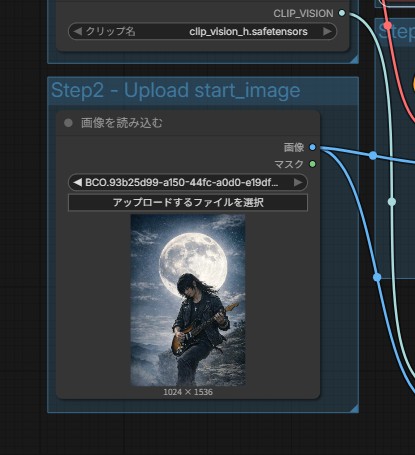

まずは画像をいれます。

プロンプトはコパイロットに考えてもらいました。

プロンプトは、やってほしい、そうなってほしいことで、

上の緑の枠の中に書いてあります。

ネガティブプロンプトは、除外や、やめてほしいことで、

下の赤い枠の中に書いてあります。

結果はこんな感じ。恰好いいのではないでしょうか?

一応node(ブロック)の全体像を貼っておきます。

申し訳ないのですが、同じブロックをまねて組み立ててもできます。

もしかしたら、テキストから生成のnodeで、最初に画像取り込みをつけたかもしれません。

どちらにしても基本のシンプルなタイプではあります。

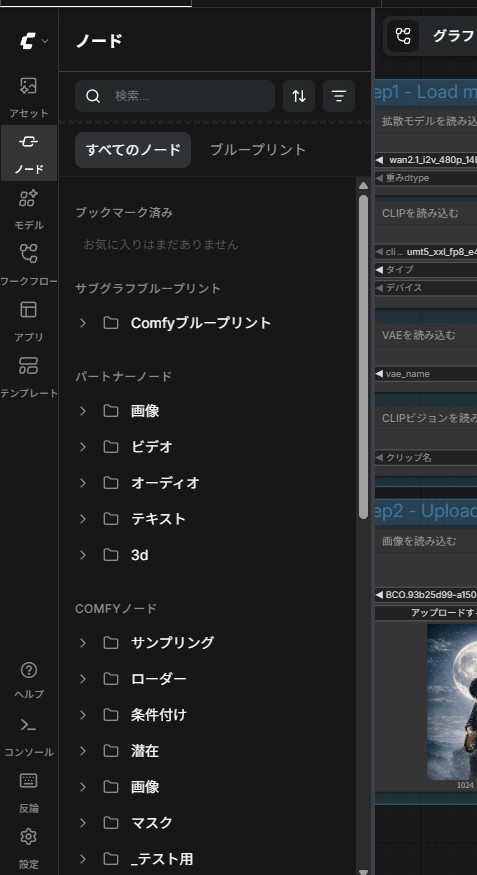

個別のノードはComfyUIの左側の、ノードから選んでセットできます。

テンプレートは有料の物もありますので、注意してくださいね。

まとめ

今回は画像生成まではCopilotを使用して時短してみた。

Copilotの画像は著作権がないのでその辺りの心配はない。

そのうちStable Diffusionも記事にしようと思います。(あまり詳しくはない)

Stable DiffusionはcheckpointやLoraによっては著作権があったりするので注意が必要。

無料で動画となると、最初の設定は大変である。

その代わり設定してしまえば、結構簡単に動画ができる。

プロンプトの英語がわからなければAIが教えてくれる。

何より、自分の動画がワンポイントでプロぽっくなる。

お詫び

今回思ったより中身が多くて、無料動画編集のShotCutについては書けませんでした。

本当にいいソフトで、私はもう何年もこれ1本なんです。

この記事に追記するか、別建てでいずれ特集したいと思います。